- LightGBM 官方文档

- 阿水知乎贴:《你应该知道的LightGBM各种操作》

- Python API(包括Scikit-learn API)

- 《Coggle 30 Days of ML(22年1&2月)》

学习内容:

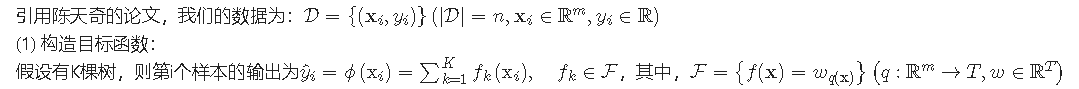

LightGBM(Light Gradient Boosting Machine)是微软开源的一个实现 GBDT 算法的框架,支持高效率的并行训练。LightGBM 提出的主要原因是为了解决 GBDT 在海量数据遇到的问题。本次学习内容包括使用LightGBM完成各种操作,包括竞赛和数据挖掘中的模型训练、验证和调参过程。

打卡汇总:

| 任务名称 | 难度、分数 | 所需技能 |

|---|---|---|

| 任务1模型训练与预测 | 低、1 | LightGBM |

| 任务2:模型保存与加载 | 低、1 | LightGBM |

| 任务3:分类、回归和排序任务 | 高、3 | LightGBM |

| 任务4:模型可视化 | 低、1 | graphviz |

| 任务5:模型调参(网格、随机、贝叶斯) | 中、2 | 模型调参 |

| 任务6:模型微调与参数衰减 | 中、2 | LightGBM |

| 任务7:特征筛选方法 | 高、3 | 特征筛选方法 |

| 任务8:自定义损失函数 | 中、2 | 损失函数&评价函数 |

| 任务9:模型部署与加速 | 高、3 | Treelite |